Crédit illustration : NASA/ESA/Hubble/STScI – Notre univers en expansion depuis le champ ultra profond du télescope spatial Hubble.

La presse française, scientifique ou non, se fait depuis peu l’écho d’une « tension » dans les mesures de la constante de Hubble. Voyons cela.

Commençons par le commencement : c’est quoi la constante de Hubble ?

Prenez un télescope. Regardez plein d’objets célestes. Vous allez remarquer que plus ils sont loin plus ils s’éloignent vite. De surcroît, ces deux grandeurs, vitesse d’éloignement et distance, sont proportionnelles. Plus c’est loin plus ça s’éloigne vite [1]. Le facteur de proportionnalité, c’est justement la fameuse « constante de Hubble », symbole « H ». Je vous propose un survol de son histoire.

Une brève histoire de H

Tout commence avec Hubble en 1929. Il mesure ce que dont je viens de parler. Il en déduit,

H = 500 km/s/Mpc.

Ça veut dire quoi au juste ? Ça veut dire que deux points de l’univers éloignés de 1 « mega parsec » (1 Mpc), c’est-à-dire 3,2 millions d’années lumières, s’éloignent l’un de l’autre à la vitesse de 500 kilomètres par seconde. S’ils sont éloignés de 2 fois plus, c’est-à-dire 2 Mpc, ils s’éloignent l’un de l’autre à la vitesse de 2 x 500=1 000 km/s. S’ils sont 4 fois plus loin, c’est à dire 4 Mpc, ils s’éloignent l’un de l’autre à 4 x 500=2 000 km/s. Etc[2].

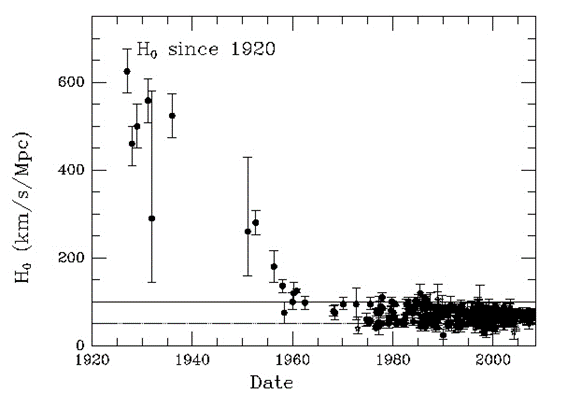

Les décennies suivantes furent témoins d’une intense activité astronomique destinée à cadrer la valeur de H. On peut voir sur le diagramme ci-dessous le résultat de mesures successives depuis 1929 (source),

Comme on le voit, les mesures s’affinèrent au fil des ans et convergèrent vers une fourchette comprise entre 50 et 100. Un zoom sur la partie droite montre que la fourchette se resserre autour de l’intervalle 60-80 à partir des années 2000.

Récents développements

La figure ci-dessus s’arrête un peu avant 2010. Les mesures ont bien sûr continué, principalement dans deux directions (il y en a plus, mais l’essentiel est là),

- Les mesures directes, « à la Hubble », qui consistent à observer de nombreux objets célestes et à comparer leur distance avec leur vitesse d’éloignement. Elles portent l’étiquette « Distance Ladder» dans la figure ci-dessous.

- Les mesures indirectes, plus difficiles à vulgariser, qui consistent à déduire la valeur de la constante de Hubble de l’analyse du Fond Diffus Cosmologique (FDM) ou des Oscillations Acoustiques de Baryons (OAB – je sais, c’est assez cryptique)[3]. Ces méthodes reposent grandement sur le modèle cosmologique physico-mathématique actuel, « LCDM »[4] pour les intimes, qui permet d’extraire la constante de Hubble de l’analyse du FDM et des OAB. Les fruits de ces mesures portent l’étiquette « LCDM » dans la figure ci-dessous.

Et là, surprise, générale je crois, les choses tournent comme ça (source),

On le voit, les mesures directes convergent vers 73 environ. Les mesures indirectes convergent vers 67. Les zones bleutées et orangées représentent les incertitudes. Jusqu’en 2013, ces deux zones se chevauchant encore partiellement, on pouvait encore penser que les deux méthodes s’accordaient pour donner le même résultat modulo les incertitudes. Depuis 2013, cette option est devenue pratiquement intenable. L’amaigrissement des barres d’erreurs montre clairement que les deux méthodes accouchent de deux valeurs différentes de la constante de Hubble, distantes d’environ 9%. Voici donc la fameuse « tension » : les mesures directes donnent 9% de plus que le modèle cosmologique dominant à l’heure actuelle.

On fait quoi maintenant ?

Ce genre de tension s’est déjà produit en physique. Juste 2 exemples : Newton et Mercure, et la constante de Hubble, déjà…

Newton et Mercure

En 1859, l’astronome français Urbain Le Verrier démontra que l’orbite de Mercure ne collait pas tout à fait avec la théorie de Newton. L’erreur était faible, certes, mais bel et bien détectable. Pour la chute des pommes, les marées, la trajectoire d’une balle ou celle de la terre, Newton prédit le résultat des choses avec une erreur indétectable[5]. Pas pour Mercure. Les gens se mirent donc en mode « wait and see ». L’attente dura plus de 55 ans puisqu’il fallut attendre la Relativité Générale d’Einstein, c’est à dire une révision de Newton, pour clore l’affaire[6]. Ce n’est pas que Newton est « faux ». Il a simplement des limites.

La constante de Hubble, déjà…

Partant de H, on peut facilement estimer le temps écoulé depuis le début de l’expansion[7] (je ne parle pas de commencement de l’univers, pour des raisons exposées ici). La valeur trouvée par Hubble en 1929 donnait entre 1 et 2 milliards d’années. S’étant convaincu de la réalité d’un univers en expansion vers 1931, Einstein fit dans les années suivantes une remarque très intéressante,

Une difficulté étrange se pose cependant. L’interprétation du décalage des lignes galactiques découvert par Hubble comme une expansion (dont on ne peut guère douter d’un point de vue théorique), conduit à une origine de cette expansion qui ne se trouve « que » à environ 1 milliards d’années, tandis que l’astronomie physique tend à montrer que le développement des étoiles individuelles et des systèmes d’étoiles prend probablement beaucoup plus de temps. On ne sait en aucun cas comment surmonter cette incongruité.

D’aucuns pourraient s’étonner qu’Einstein ne se soit pas dit « c’est fichu, l’expansion c’est du bidon ». D’autant qu’avant 1931 il était plutôt partisan d’un univers statique. Mais il savait bien que l’indicateur de l’expansion était solide[8]. Sa rapidité étant une autre paire de manche. Il se mit donc lui aussi en mode « wait and see ».

L’énigme fut résolue dans les années 50. Hubble s’était trompé d’un facteur 7 dans ses mesures de distances. Sa constante passa donc de 500 à 70, et le temps écoulé depuis le début de l’expansion de 1 ou 2 milliards d’années, à une bonne douzaine. Incongruité résolue.

La tension présente

Newton et Mercure. Constante de Hubble 1929. Constante de Hubble 2019. L’histoire se répète. Ce n’est vraiment pas la première fois qu’il y a conflit entre les observations et la théorie. Dans l’affaire Newton contre Mercure, c’est Newton qu’on a fini par amender. Dans l’affaire Hubble contre physique stellaire vers 1930, ce sont les observations de Hubble qui étaient imprécises. Et dans l’affaire présente, mesures directes contre modèle, comment résoudra-t-on la tension ? J’aurais tendance à penser que c’est le modèle « LCDM » qui sera amendé car il y a plus d’inconnues de ce côté. Déjà, les idées ne manquent pas. Il est néanmoins possible qu’il faille nous armer de patience. Comme on l’a vu, il fallut 55 ans pour résoudre l’énigme de Mercure. Wait and see, re-donc. Impatients s’abstenir.

On en reparle en 2075 ?

Notes

[1] Attention, “loin”, ça veut dire « plus de quelques millions d’années lumières », minimum.

[2] Et oui, s’ils sont assez éloignés, ils finiront par s’éloigner l’un de l’autre plus vite que la lumière. Aussi surprenant que cela puisse paraitre, cela ne contredit pas la relativité restreinte (RS), sur laquelle la relativité générale est bâtie. Si l’univers est un ballon, la RS interdit qu’un objet aille plus vite que la lumière par rapport à la surface du ballon qu’il a sous les pieds. Mais si le ballon gonfle, deux objets peuvent s’éloigner l’un de l’autre aussi vite qu’on le veut.

[3] La lecture de ce dossier sur le Big Bang est recommandée.

[4] Prononcer « Lambda C D M ». Le CDM est l’acronyme de « Cold Dark Matter », matière sombre froide.

[5] Ou presque, mais bon, passons…

[6] Rappelons que la Relativité Générale rejoint progressivement Newton quand la gravitation devient faible. C’est pour cela que l’on peut faire la différence entre les prédictions de ces 2 théories sur l’orbite de Mercure, planète la plus proche du soleil, et pas sur les autres.

[7] Les intimes auront remarqué que H est en fait l’inverse d’un temps. Si bien que 1/H est un temps, qui correspond assez bien au temps écoulé depuis le début de l’expansion.

[8] L’hypothèse de la « lumière fatiguée », principale alternative à l’interprétation du décalage vers le rouge comme une vitesse de récession, a été abandonnée pour pas mal de bonnes raisons.